大家好,我是皮皮。

一、前言

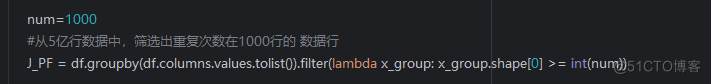

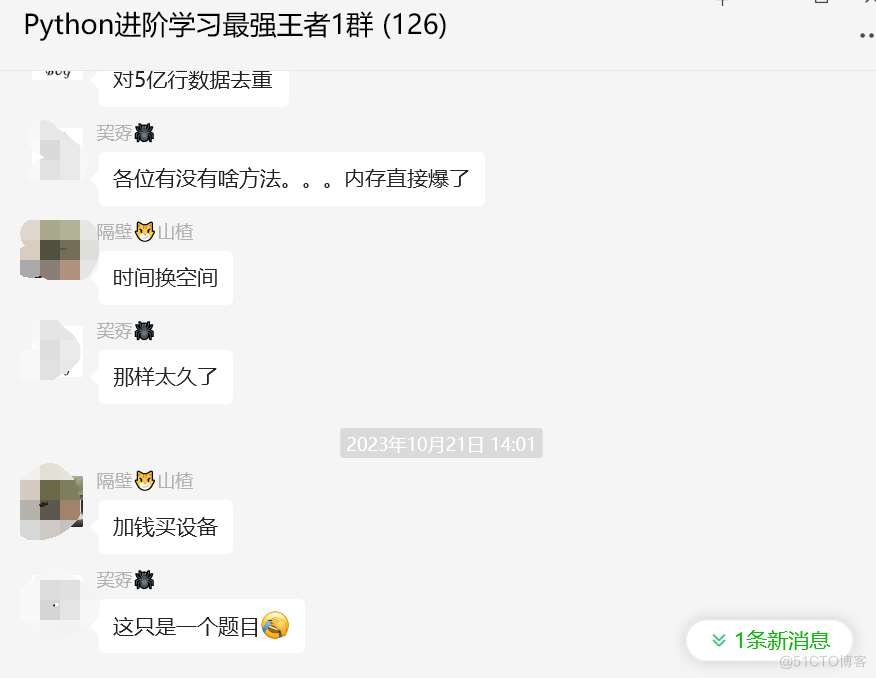

前几天在Python最强王者交流群【巭孬】问了一个问题,一起来看看吧。从5亿行数据中,筛选出重复次数在1000行的数据行,以前用这个,也爆内存了。

二、实现过程

这里【隔壁山楂】给了一个思路:如下所示:

后来【郑煜哲Xiaopang】给了个思路,全tuple后,set。后来粉丝用merge逐一并集 解决了这个问题。

原来是用concat全部连接起来,再drop_duplicates,直接爆了。

刚才的是去重,算是解决了。现在又有个新问题,下一篇文章我们一起来看看吧。

三、总结

大家好,我是皮皮。这篇文章主要盘点了一个大数据去重的问题,文中针对该问题,给出了具体的解析和代码实现,帮助粉丝顺利解决了问题。

最后感服务器托管网谢粉丝【巭孬】提问,感谢【隔壁山楂】、【郑煜哲Xiaopang】给出的思路和代码解析,感谢【莫生气】等人参与学习交流。

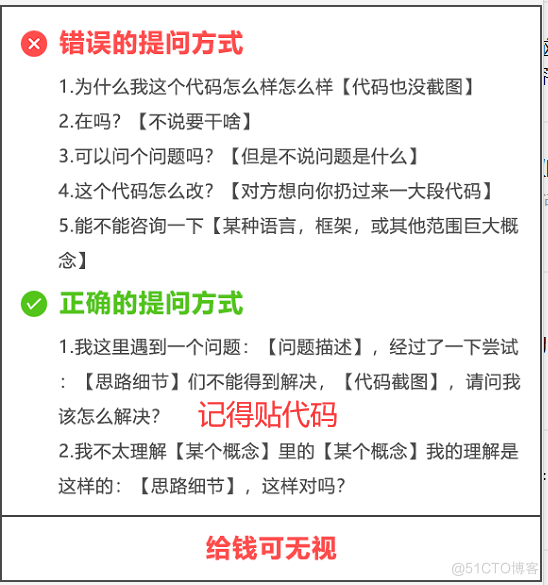

【提问补充】温馨提示,大家服务器托管网在群里提问的时候。可以注意下面几点:如果涉及到大文件数据,可以数据脱敏后,发点demo数据来(小文件的意思),然后贴点代码(可以复制的那种),记得发报错截图(截全)。代码不多的话,直接发代码文字即可,代码超过50行这样的话,发个.py文件就行。

服务器托管,北京服务器托管,服务器租用 http://www.fwqtg.net

机房租用,北京机房租用,IDC机房托管, http://www.fwqtg.net

相关推荐: 深入了解 PostgreSQL:功能、特性和部署

PostgreSQL,通常简称为Postgres,是一款强大且开源的关系型数据库管理系统(RDBMS),它在数据存储和处理方面提供了广泛的功能和灵活性。本文将详细介绍 PostgreSQL 的功能、特性以及如何部署和使用它。 什么是 PostgreSQL? P…